Évolution du NLP : de l'IA fragmentée aux modèles fondamentaux

Définitions

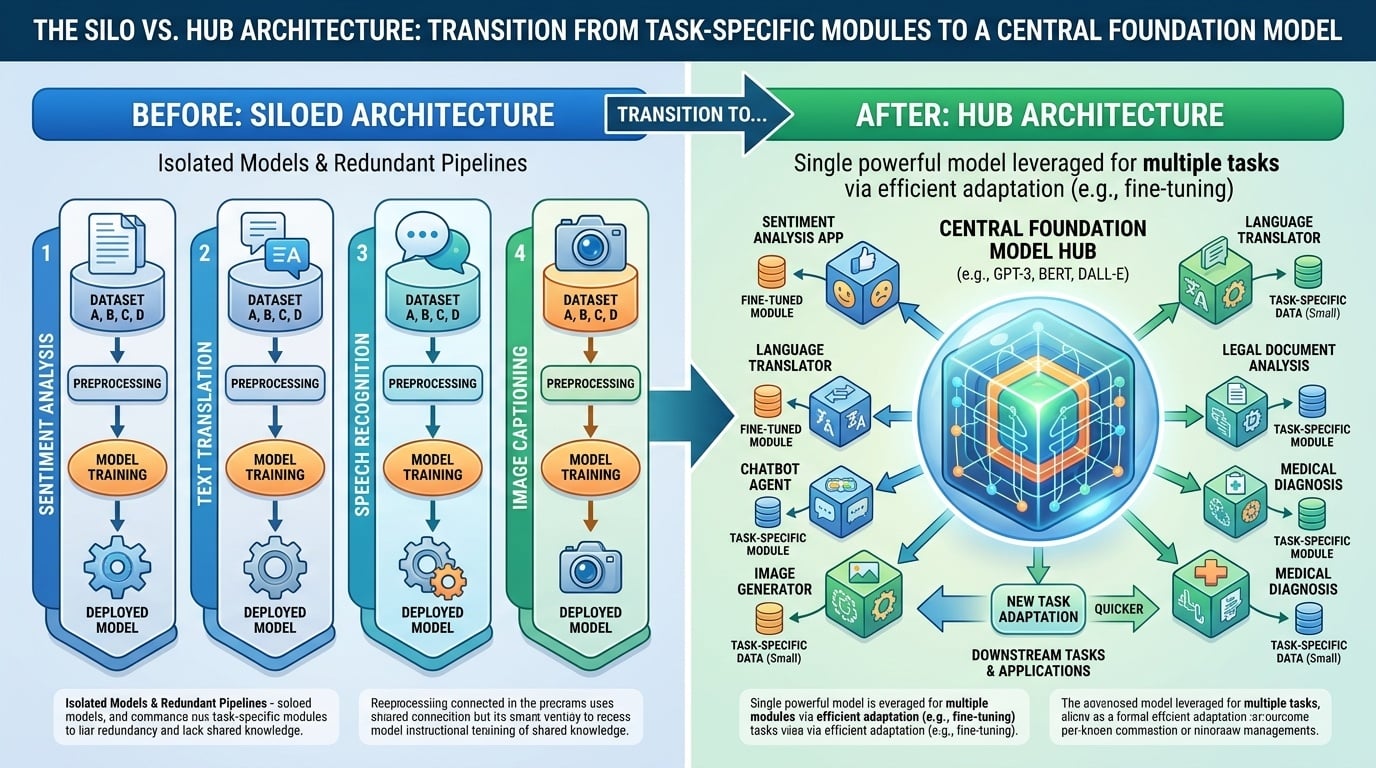

- IA fragmentée: Une ère caractérisée par des architectures neuronales discrètes et spécialisées conçues pour des tâches individuelles telles que l'étiquetage de séquences ou la classification.

- Modèle fondamental: Une architecture transformer unifiée et monolithique qui traite tous les problèmes linguistiques comme une séquence générative texte-à-texte $x \rightarrow y$.

Concepts fondamentaux

- Consolidation architecturale : Historiquement, le NLP nécessitait des pipelines sur mesure (Bi-LSTM pour le NER, CNN pour le sentiment). Les LLM réduisent ces silos en un seul squelette central où les mêmes poids sont utilisés pour toutes les tâches.

- L'interface unifiée : Les LLM remplacent les "têtes de sortie" spécialisées (par exemple, Softmax à 3 classes) par une interface en langage naturel. Les entrées et sorties sont toujours des chaînes de caractères, permettant au modèle d'interpréter l'intention plutôt que le format.

- Transfert de connaissances : Les modèles traditionnels étaient "une feuille blanche" pour chaque tâche. Les LLM privilégient La généralisation en premier, où les tâches spécifiques ne sont que des applications d'une représentation interne préexistante et robuste du langage.

Contexte historique

- Avant 2018 : L'isolement des tâches exigeait l'entraînement de modèles distincts avec des fonctions de perte différentes $\mathcal{L}_{task}$.

- Ère moderne : Le paradigme "texte-à-texte" permet à un seul modèle (par exemple, Llama-3) de pivoter entre les tâches grâce à une incitation zéro-tâche ou peu de tâches.

Comparaison de l'implémentation Python